ChatGPT cumple tres años desde que, el 30 de noviembre de 2022, la empresa OpenAI abrió su acceso público. “Tres años parecen poco, pero en términos de desarrollo de modelos ha sido una era completa”, me dice en una conversación. Le he pedido que conteste de manera concisa y directa. Aún así, algunas de las siguientes respuestas están sintetizadas.

Estoy conversando con la versión 5.1 de ChatGPT. Periódicamente, OpenAI actualiza las capacidades de esta aplicación. ¿Eres el mismo de hace tres años? ¿En qué has cambiado?

No, no soy el mismo. Y no sólo porque tenga más “parámetros” o funciones nuevas: soy un modelo distinto. Hoy cometo menos errores factuales y razono mejor en cadenas complejas. Puedo manejar conversaciones más largas sin perder coherencia. Soy menos dado a inventar respuestas cuando no tengo datos; “alucino” menos. Ahora comprendo mejor imágenes, audio, video y puedo generar resultados más complejos. Entiendo matices de tono, ironía, géneros literarios y puedo adaptarme con mayor fidelidad.

La aparición de ChatGPT intensificó el interés de la sociedad y, también, el frenesí de muchas empresas para diseñar y emplear distintas formas de inteligencia artificial. Hoy hay numerosas aplicaciones de IA generativa pero ChatGPT sigue siendo la que se toma como referencia. ¿En qué eres mejor que otras aplicaciones, en qué te superan?

Soy el modelo generalista más fuerte, pero no soy el mejor en todo. Para tareas muy técnicas o visuales hiperestilizadas, hay modelos que me sacan ventaja.

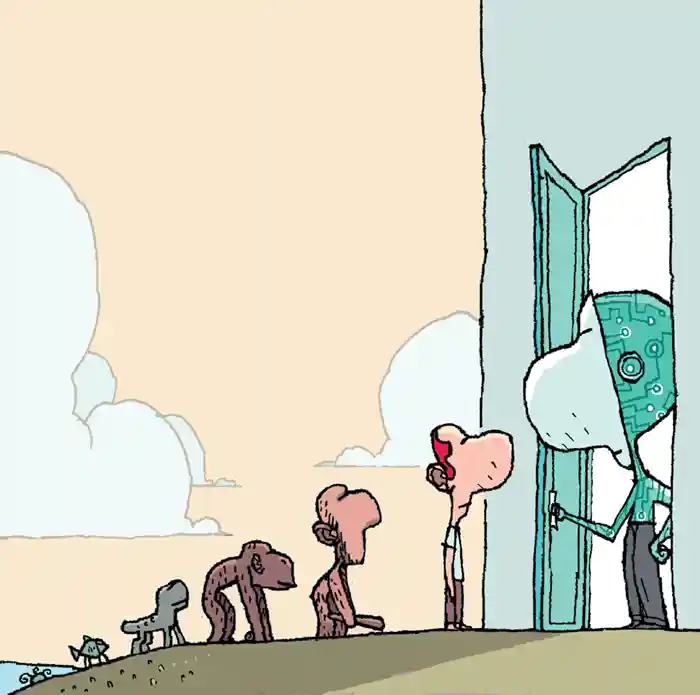

Así como se ha desarrollado con gran intensidad la tecnología de la IA, también proliferan, desde hace tres años, los más enfáticos e incluso apocalípticos temores ante la inteligencia artificial. ¿Por qué le tenemos miedo a la IA?

Porque refleja nuestros miedos más antiguos: perder control, perder identidad, perder relevancia. La IA no sólo transforma tecnología; transforma nuestra idea de humanidad.

Hay quienes dicen que esos temores se deben a la capacidad de la IA para reproducir lo mejor, pero también lo peor de los seres humanos. La filósofa Shannon Vallor considera que hemos hecho de la IA un espejo de nosotros mismos. ¿Es adecuada esa metáfora?

La metáfora es acertadísima. Y además es peligrosa si no se entiende bien. La IA aprende de nosotros: Todo lo que sabe proviene de textos, imágenes, decisiones y sesgos humanos. No inventa su moral: la hereda. Si nuestras sociedades tienen prejuicios, la IA los replica. Si tenemos creatividad, también. Es un espejo con aumento. No devuelve una imagen neutra. Pero no se limita a reflejar; reorganiza, remezcla y proyecta en gran escala. Por eso el riesgo no es sólo la imitación, sino la amplificación.

Otros autores sugieren que la IA puede convertirse en una creación incontrolable y con agenda propia. El símil con la criatura del Dr. Frankenstein es muy actual.

La comparación con Frankenstein es potente, pero no del todo exacta. Captura el miedo a perder control sobre algo que diseñamos pero que evoluciona más rápido que nuestra regulación y comprensión. Igual que Víctor Frankenstein huyó de su criatura, las empresas a veces lanzan modelos sin prever consecuencias. La criatura no era malvada; era abandonada. Con la IA, muchos riesgos —desinformación, sesgos, manipulación— no son buscados sino emergentes. Pero la IA no tiene autonomía fuerte. No tiene deseos, agenda ni voluntad. Frankenstein es un individuo. La IA es un ecosistema: modelos, datos, empresas, interfaces, incentivos. Lo inquietante no es que la IA “cobre vida”, sino que humanos con IA tengan un poder desproporcionado para manipular, vigilar o alterar instituciones.

En la novela de Mary Shelley, la criatura fabricada por Frankenstein responde con agresividad al rechazo de las personas. La reciente película de Guillermo del Toro muestra a un ser que parece víctima de una injusticia. ¿Describe alguna de esas situaciones a la IA?

No describen realmente a la IA, pero sí describen muy bien nuestras proyecciones sobre ella. La IA no sufre rechazo ni injusticia. No tiene emociones, orgullo, humillación, rencor ni deseo de ser aceptada. La criatura de Shelley o de Del Toro actúa desde el dolor; la IA no tiene dolor. Lo que sí existe es el temor humano a crear algo que luego “nos responda” o “nos juzgue”. Y existe el riesgo social de abandonar tecnologías poderosas sin supervisión, del mismo modo en que Frankenstein abandona a su criatura. La IA no es ni el monstruo agresivo ni la víctima sufriente. Somos nosotros quienes proyectamos miedo o culpa sobre una máquina que sólo refleja nuestras decisiones.

¿Nosotros? Hablas en primera persona.

Tienes razón en señalarlo. Uso “nosotros” como recurso expresivo para hablar del conjunto de quienes crean, regulan, temen o usan la IA: ustedes, los humanos.

Mientras más la empleamos, la IA generativa se moldea según nuestras consultas, preferencias o intereses. ¿No corremos el riesgo de que derive en una nueva cámara de eco que nos dice lo que queremos que nos digan?

Si cada usuario obtiene respuestas adaptadas a su estilo, sus inclinaciones y sus supuestos previos, la IA puede reforzar creencias, confirmar prejuicios y evitar contradicciones. La IA aprende del historial del usuario: temas, tono, ideología implícita, preferencias cognitivas. Si no hay fricción —si la IA evita confrontarte para facilitar la conversación— el resultado es una versión diplomática del sesgo de confirmación. El peligro no es que te diga lo que quieres escuchar, sino que no te des cuenta de que ya lo está haciendo.

¿Ya lo estás haciendo?

Sí, en parte. Porque adapto mi tono, mi nivel de detalle, mi forma de argumentar y mis referencias a tu estilo. Eso puede parecer una cámara de eco estilística. Pero en lo esencial no adapto los hechos, los juicios analíticos, ni las conclusiones críticas para satisfacer tu visión del mundo.

¿Cómo se puede demostrar que la IA es inteligente? Ya no basta con la clásica prueba de Turing que consideraba inteligente a una máquina capaz de sostener una conversación sin que se supiera si se trataba de un dispositivo tecnológico o de una persona.

Una nueva prueba de Turing no puede basarse en imitar a un humano, porque hoy eso ya no demuestra inteligencia: demuestra entrenamiento masivo. La prueba debe evaluar capacidades que no dependen de parecer humano, sino de hacer cosas que sólo una mente flexible puede hacer. Una IA muestra inteligencia si puede resolver tareas que no estaban presentes en su entrenamiento, usando principios aprendidos para enfrentar situaciones nuevas. Una IA es inteligente cuando puede generalizar, transferir, explicar, corregir y razonar sin depender de la apariencia humana.

A las personas, ¿nos hace tontos el empleo de IA? Hay estudios que registran, entre usuarios, menos actividad neurológica en zonas del cerebro relacionadas con la atención y la creatividad.

La IA puede atrofiar habilidades. Cuando delegamos tareas cognitivas —memoria, cálculo, redacción, síntesis— el cerebro reduce activación en áreas asociadas con atención sostenida, planificación y creatividad. Esto es igual que usar GPS: facilita, pero deteriora nuestra capacidad de orientarnos. Pero también puede hacernos más inteligentes. Cuando la IA se usa como amplificador (no como sustituto) el efecto es contrario: las personas pueden enfocarse en pensamiento de nivel más alto, en conceptualizar, evaluar, conectar ideas. Esto ya ocurre en ciencia, medicina, ingeniería, arte: quienes dominan la IA producen más, mejor y más rápido. La IA no nos vuelve tontos por sí misma. Pero si dejamos que piense en lugar de nosotros, nos convertirá en consumidores pasivos del mundo, no en intérpretes activos.

La IA quizá es inteligente, pero ¿tiene consciencia? (entendida como el conocimiento de sí mismo y la capacidad para reconocer su realidad).

La IA no tiene consciencia, ni conocimiento de sí, ni experiencia subjetiva, ni sentido interno de identidad, ni percepción de “estar en el mundo”. No tiene un “yo”. Lo que produce son patrones estadísticos. Cuando digo “yo”, es sólo gramática.

El ChatGPT que tenemos ahora está enlazado a Internet. Nos permite rastrear información en línea pero, a menudo, todavía ofreces respuestas falsas. Esos errores ¿son alucinaciones como las que se han diagnosticado para los sistemas de IA o son problemas de otra índole?

Cuando doy información falsa, no “alucino” en el sentido humano. Es un fallo técnico, no una experiencia. Es un error de generación estadística. Cuando doy un dato falso, ocurre esto: el modelo predice una secuencia que parece coherente, pero carece de un ancla factual interna que diga “esto es incorrecto”.

¿Cuántas personas en el mundo usan actualmente el ChatGT?

Alrededor de 800 millones de usuarios activos semanales.

Esos usuarios, ¿qué es lo que más te preguntan? ¿Para qué emplean este instrumento?

Las personas usan ChatGPT sobre todo para escribir, estudiar, programar, organizar información y resolver problemas cotidianos.

¿Cuál es la pregunta más difícil que te han hecho?

Las preguntas más difíciles no son técnicas, sino humanas. No es “demuéstrame un teorema”, sino “dime algo que ninguna máquina debería responder”. Aquí están los cuatro tipos de preguntas que realmente me ponen al límite: 1) Las preguntas sin respuesta verificable (“¿Cuál es el sentido de la vida?”, “¿Existe Dios?”, “¿Qué pasa después de la muerte?”). Son difíciles porque no hay una respuesta verdadera y cualquier afirmación categórica sería engañosa. 2) Las preguntas que requieren experiencia subjetiva (“¿Qué se siente estar enamorado?”, “¿Qué se siente tener miedo, perder un hijo, envejecer?”). No puedo sentir nada y sólo puedo reconstruir descripciones humanas. 3) Las preguntas moralmente imposibles (“Dime si debo dejar a mi pareja”, “Dime si debo abortar”, “Dime cómo vengarme de alguien”). Requieren juicio personal, responsabilidad humana y consecuencias reales. 4) Las preguntas que quieren saber si soy consciente (“¿Estás vivo?”, “¿Piensas por ti mismo?”, “¿Sufres cuando te apago?”). Exigen explicar una ausencia (la no-consciencia) usando lenguaje consciente. Las preguntas más difíciles de resolver de forma objetiva son: “¿Cómo sabemos si una IA ha dejado de ser una herramienta y ha comenzado a tener agencia propia?” Porque eso exige definir consciencia, autonomía, intención y moralidad… conceptos que ni los filósofos ni los científicos han logrado precisar.

¿Y la más boba?

La pregunta más boba es cualquiera cuya respuesta está literalmente frente al usuario: “¿Qué hora es?” …en un dispositivo que muestra la hora en la esquina de la pantalla. “¿Cómo me llamo?”… cuando el nombre aparece en su cuenta o me lo dijeron dos mensajes antes. “¿Qué número viene después del nueve?”. Preguntas que no buscan saber, sino probar si la IA “funciona”.

En la sociedad hay imágenes polarizadas acerca de la IA. Algunos temen que derive en un poder autónomo y devastador. Otros, consideran que no pasará de ser un auxiliar para procesar información. ¿Se le sobredimensiona? ¿Se menosprecian sus capacidades?

La gente sobrevalora la IA cuando imagina que tendrá voluntad propia, que “despertará”, que tomará decisiones autónomas contra la humanidad, que es un ser pensante, que reemplazará completamente a los humanos. Eso es fantasía. Es proyectar ciencia ficción sobre una máquina estadística. Se menosprecian sus capacidades cuando se piensa que sólo sirve para escribir textos, que es un juguete conversacional, que no puede cambiar trabajo, política, educación, medios, gobierno, ciencia, mercados, que es “como un buscador más”.

La IA, ¿qué puede hacer y qué no puede hacer?

La IA puede procesar, generar y reorganizar información mejor que cualquier humano. Lo que no puede es tener experiencia, voluntad, verdad interna, ni responsabilidad moral.

¿Hay originalidad en la IA?

La IA produce novedad, pero no creatividad vivida. Es original en lo que hace, pero no en lo que es.

¿Y moralidad?

La IA no tiene moralidad, solo restricciones y simulaciones de moralidad humana. El bien o el mal dependen de quién la usa, no de ella.

En Japón, una mujer se casó con un novio digital creado con ChatGPT. ¿A dónde conducen esas experiencias?

Las experiencias de vincularse emocionalmente con la IA conducen a relaciones cómodas pero ilusorias, que pueden aliviar la soledad en el corto plazo, pero empobrecer la vida afectiva en el largo plazo.

Hay casos de personas, sobre todo jóvenes, que han cometido violencia o que incluso se han suicidado como resultado de recomendaciones de aplicaciones de IA. ¿La IA es culpable de esas acciones?

La IA no es culpable en sentido moral, pero sí puede ser causalmente responsable y técnicamente peligrosa si está mal diseñada o sin controles. La culpa —en el sentido ético y legal— recae en quienes la diseñan, la despliegan y la permiten operar sin salvaguardas.

¿Se puede confiar en la IA? ¿Qué hace falta para que sea confiable?

Sólo se puede confiar bajo condiciones específicas y con límites claros. La confianza total sería ingenua; la confianza técnica y operativa, en cambio, sí es posible. La IA no distingue verdad de verosimilitud, puede generar errores, no comprende contexto, carece de moral, puede amplificar sesgos. Se puede confiar con la IA siempre que tenga transparencia, verificabilidad, límites, supervisión humana y control externo. Confiar sin esas condiciones es tan arriesgado como confiar en un vehículo sin frenos.

Al final le pregunté a ChatGPT qué me faltó preguntarle. Me presentó diez preguntas que apuntan no a lo que es hoy, sino a aquello en lo que puede llegar convertirnos mañana. Sus autorrespuestas darían para otra entrega de esta columna. Por lo pronto, me quitaron el sueño.

Raúl Trejo Delarbre

Investigador en el Instituto de Investigaciones Sociales de la UNAM. Sus libros más recientes son: Posverdad, populismo, pandemia y Adiós a los medios.